„Never trust, always verify.“

Das ist der Slogan von Zero Trust. Jeder kennt ihn. Jeder nickt, wenn er fällt. Aber was bedeutet er eigentlich wirklich? Und, warum ist dieses Konzept nicht nur ein Marketing-Buzzword, sondern mathematisch fundiert?

Lass mich dir zeigen, warum Zero Trust keine Modeerscheinung ist, sondern die logische Konsequenz aus dem, was wir über Wahrscheinlichkeitsrechnung und Risikomanagement wissen.

Das Problem mit dem implizitem Vertrauen

Das alte Sicherheitsmodell basierte auf Vertrauen. Wenn du hinter der Firewall bist, bist du vertrauenswürdig. Wenn du das richtige Passwort hast, bist du der, der du vorgibst zu sein. Wenn ein System im internen Netzwerk steht, kann es auch anderen internen Systemen vertrauen.

Das Modell hat einen Namen: Castle-and-Moat. Die Burg mit dem Wassergraben. Wer drin ist, gehört dazu.

Das Problem ist aber: Die Annahme, dass alles innerhalb der Mauern vertrauenswürdig ist, ist falsch. Spektakulär und nachweisbar falsch!

Insider-Bedrohungen existieren und stellen reale Gefahren dar. Kompromittierte Accounts existieren. Lateral Movement ist der Standard in modernen Angriffen. Der Perimeter ist keine Grenze mehr sondern nur mehr eine Illusion.

Vertrauen als Wahrscheinlichkeit definiert

Hier wird es mathematisch interessant. Vertrauen ist keine binäre Größe. Es ist eine kontinuierliche Wahrscheinlichkeit.

Wenn ich sage „Ich vertraue diesem Benutzer“, sage ich eigentlich: „Die Wahrscheinlichkeit, dass dieser Benutzer legitim ist und keine bösen Absichten hat, ist hoch genug, dass ich bereit bin, ihm Zugang zu gewähren.“

Wie hoch ist nun hoch genug? Das hängt ganz davon ab, was auf dem Spiel steht. Für den Zugang zum Intranet-Portal reicht vielleicht eine 95%-ige Wahrscheinlichkeit. Für den Zugang zu kritischen Finanzdaten brauchst du aber schon eine Wahrscheinlichkeit von 99,9%.

Zero Trust formalisiert diese Überlegung. Statt implizit zu sagen „Der ist drin, also vertrauen wir ihm“, fragt Zero Trust explizit: „Wie wahrscheinlich ist es, dass diese Anfrage legitim ist? Und wie können wir diese Wahrscheinlichkeit erhöhen?“

Da hilft das Bayesianische Denken

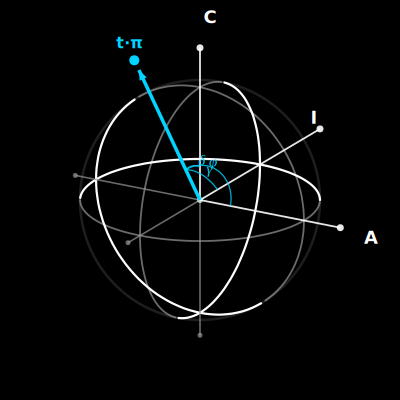

Die mathematische Grundlage dazu ist das Bayes-Theorem. Es beschreibt, wie wir unsere Einschätzung einer Wahrscheinlichkeit aktualisieren sollten, wenn neue Informationen vorliegen und berücksichtigt werden sollen.

Stell dir vor, ein Benutzer loggt sich ein. Deine Vorab-Einschätzung (Prior): 99% der Logins sind legitim. Dann sind 1% kompromittierte Accounts.

Jetzt beobachtest du: Der Login kommt von einer neuen IP-Adresse. Das verändert die Wahrscheinlichkeiten. Denn legitime Benutzer loggen sich nur gelegentlich von neuen IPs ein (sagen wir, in 5% der Fälle). Kompromittierte Accounts nutzen aber fast immer neue IPs (sagen wir, in 90% der Fälle).

Mit dem Bayes-Theorem kannst du jetzt deine Einschätzung aktualisieren. Die a Posterior-Wahrscheinlichkeit, dass der Login kompromittiert ist, ist nach dieser Beobachtung höher als vorher.

Und jetzt beobachtest du noch weitere Faktoren: Tageszeit, Gerät, Verhaltensmuster, Location u.s.w. Jede Beobachtung aktualisiert deine aktuelle Einschätzung. Am Ende hast du eine fundierte Wahrscheinlichkeit für die Entscheidung und nicht nur so ein Bauchgefühl.

Das ist genau das, was moderne Zero-Trust-Systeme im Hintergrund wirklich tun. Sie sammeln Signale, berechnen Wahrscheinlichkeiten, und entscheiden dann, ob der Zugang gewährt wird oder nicht oder ob vielleicht noch zusätzlichen Verifizierungsschritte notwendig sind, wenn die Wahrscheinlichkeit grenzwertig ist.

Die Mathematik der Kontrollen

Ein weiterer mathematischer Aspekt: Warum helfen mehrere Kontrollen?

Stell dir vor, eine einzelne Kontrolle, sagen wir einmal, ein Passwort, hat eine Versagenswahrscheinlichkeit von 1%. In einem von hundert Fällen funktioniert sie nicht (weil das Passwort gestohlen wurde, geraten wurde oder was auch immer).

Wenn du eine zweite, unabhängige Kontrolle hinzufügst, sagen wir, einen zweiten Faktor und dieser hat ebenfalls eine Versagenswahrscheinlichkeit von 1%, dann ist die kombinierte Versagenswahrscheinlichkeit 0,01%. Also ein Faktor von 100.

Das ist die Mathematik hinter Defense-in-Depth und Multi-Faktor-Authentifizierung. Unabhängige Kontrollen multiplizieren ihre Effektivität. (Stichwort: Wahrscheinlichkeitsbaum)

Zero Trust institutionalisiert dieses Prinzip. Statt einer einzigen großen Kontrolle am Perimeter gibt es viele kleine Kontrollen an vielen Punkten im Netzwerk. Jede einzelne ist umgehbar. Aber alle zusammen? Die Wahrscheinlichkeit dafür, dass alle gleichzeitig zu umgehen sind, sinkt rasant.

Die kontinuierliche Validierung

Das klassische Modell prüft einmal und zwar beim Login und gewährt dann Zugang oder nicht. Das Zero-Trust-Modell prüft nun kontinuierlich.

Warum? Weil sich Wahrscheinlichkeiten über die Zeit ändern.

Im Moment des Logins war die Wahrscheinlichkeit eines legitimen Zugangs vielleicht 99,9%. Aber nach drei Stunden, in denen der Benutzer ungewöhnliches Verhalten zeigt wie z.B. Zugriffe auf Systeme, die er sonst nie benutzte oder Downloads von ungewöhnlich großen Datenmengen Oderaber auch Logins zu außergewöhnlichen Tages- oder Nachtzeiten, dann sinkt auch die ursprüngliche Wahrscheinlichkeit der Vertrauenswürdigkeit.

Kontinuierliche Validierung aktualisiert die Einschätzung in Echtzeit. Und wenn die Wahrscheinlichkeit unter einen bestimmten Schwellwert fällt, reagiert das System sofort durch zusätzliche Verifizierungsmethoden, durch Einschränkung von aktuellen Zugriffen oder durch Alarmierung des entsprechenden Security-Teams.

Die Mikrosegmentierung

Mikrosegmentierung ist dafür ein weiterer und essentieller Baustein von Zero Trust. Auch er hat eine mathematische Fundierung.

Stell dir vor, ein Angreifer kompromittiert ein System. Im alten Modell, mit einem flachen Netzwerk, kann er von dort aus jeden Ort im Netz erreichen. Im segmentierten Modell muss er jedoch jede Grenze einzeln überwinden und jede Kontrolle erfolgreich passieren um sich im Netzwerk erfolgreich bewegen zu können.

Die Wahrscheinlichkeit, dass er sein Ziel erreicht, ist das Produkt der Wahrscheinlichkeiten, jede einzelne Barriere zu überwinden. Wenn er fünf Segmentgrenzen überwinden muss und jede eine 50%-ige Erfolgswahrscheinlichkeit hat, dann ist seine Gesamtwahrscheinlichkeit allerdings nur mehr 3,125% für einen Erfolg. Das ist auch für das Risikoassessment essenziell.

Natürlich sind diese Zahlen vereinfacht. Aber das Prinzip ist klar: Mehr Grenzen, niedrigere Gesamtwahrscheinlichkeit des Erfolgs.

Die Grenzen von Zero Trust

Bevor jetzt allerdings der Eindruck entsteht, Zero Trust sei DAS Allheilmittel. Hier die schlechte Nachricht: Sie ist es Nicht!

Erstens: Zero Trust schützt nicht vor allem. Wenn ein Angreifer in den Besitz aller Faktoren gekommen ist wie z.B. das Passwort, das Gerät, die Verhaltensbiometrie, dann ist er für das System vom legitimen Benutzer nicht mehr zu unterscheiden. Die Wahrscheinlichkeit erreicht also, wie immer, nie 100%.

Zweitens: Zero Trust hat Kosten. Mehr Kontrollen bedeuten mehr Friction für die Benutzer. Mehr Entscheidungspunkte bedeuten mehr Latenz. Mehr Signale bedeuten mehr Komplexität. Das Optimum liegt sicher nicht bei „unendlich vielen Kontrollen“. Es ist hier also ein wohl definierte Trade-Off zur Entscheidung an.

Drittens: Zero Trust erfordert Daten. Um Wahrscheinlichkeiten berechnen zu können, brauchst du Signale wie z.B. Logging, Telemetrie, Verhaltensanalyse. Ohne entsprechender Visibility auch kein Zero Trust.

Von der Theorie zur Praxis

Was bedeutet das konkret für die Umsetzung?

Denke in Wahrscheinlichkeiten. Frage bei jeder Kontrolle: Wie viel Konfidenz gewinne ich damit? Und, wie kann ich die Konfidenz erhöhen, wenn es nötig ist?

Implementiere Kontext-Awareness. Ein Login von einem bekannten Gerät, zu einer normalen Zeit, von einem normalen Ort ist anders zu bewerten als ein Login von einem neuen Gerät, um 3 Uhr morgens, aus einem anderen Land.

Nutze Risiko-basierte Authentifizierung. Nicht jeder Zugriff braucht dieselbe Verifizierungsstufe. Die Unternehmenszeitung auf dem Intranet: niedrig. Zugriff auf Finanzdaten: hoch. Adaptive Kontrollen passen sich dem Risiko entsprechend an.

Baue Feedback-Schleifen ein. Die Wahrscheinlichkeiten, die dein System berechnet, sollten gegen die Realität geprüft werden. Wie viele der als riskant eingestuften Logins waren tatsächlich Angriffe? Kalibriere dein Modell kontinuierlich.

Das Mindset ist der eigentliche Wandel

Am Ende ist Zero Trust weniger eine Technologie als ein Mindset. Es ist die Akzeptanz dessen, dass wir nie vollständiges Wissen haben werden. Dass jede Einschätzung eine Wahrscheinlichkeit ist und keine Gewissheit. Dass wir alles kontinuierlich validieren müssen, weil sich die Welt ständig verändert.

Die Mathematik untermauert nur, was intuitiv richtig klingt: Vertraue nicht blind. Sammle Evidenzen. Aktualisiere deine Einschätzungen und handle entsprechend.

Zero Trust ist keine Revolution. Es ist die konsequente Anwendung der Wahrscheinlichkeitsrechnung auf das Problem der Zugriffskontrolle.

Und deshalb wird es bleiben, auch wenn der Hype irgendwann abklingt.

—

Für die praktische Umsetzung empfehle ich die NIST Special Publication 800-207: Zero Trust Architecture. Sie ist überraschend lesbar und bietet einen guten Rahmen für die Implementierung.